Introdução

O comportamento de consumo humano é um campo vasto e multifacetado, profundamente influenciado por fatores psicológicos, sociais, culturais e econômicos. Tradicionalmente, os profissionais de marketing se concentraram em modelos estáticos e simplistas, segmentando os consumidores com base em variáveis como idade, gênero, localização geográfica e renda. Entretanto, conforme o entendimento sobre a evolução da consciência humana avança, surgem novas maneiras de compreender o comportamento de compra que vão além desses fatores superficiais. Uma dessas abordagens inovadoras é oferecida pela Teoria Integral de Ken Wilber, que propõe uma visão abrangente da consciência humana e suas implicações em várias áreas, incluindo o comportamento de consumo.

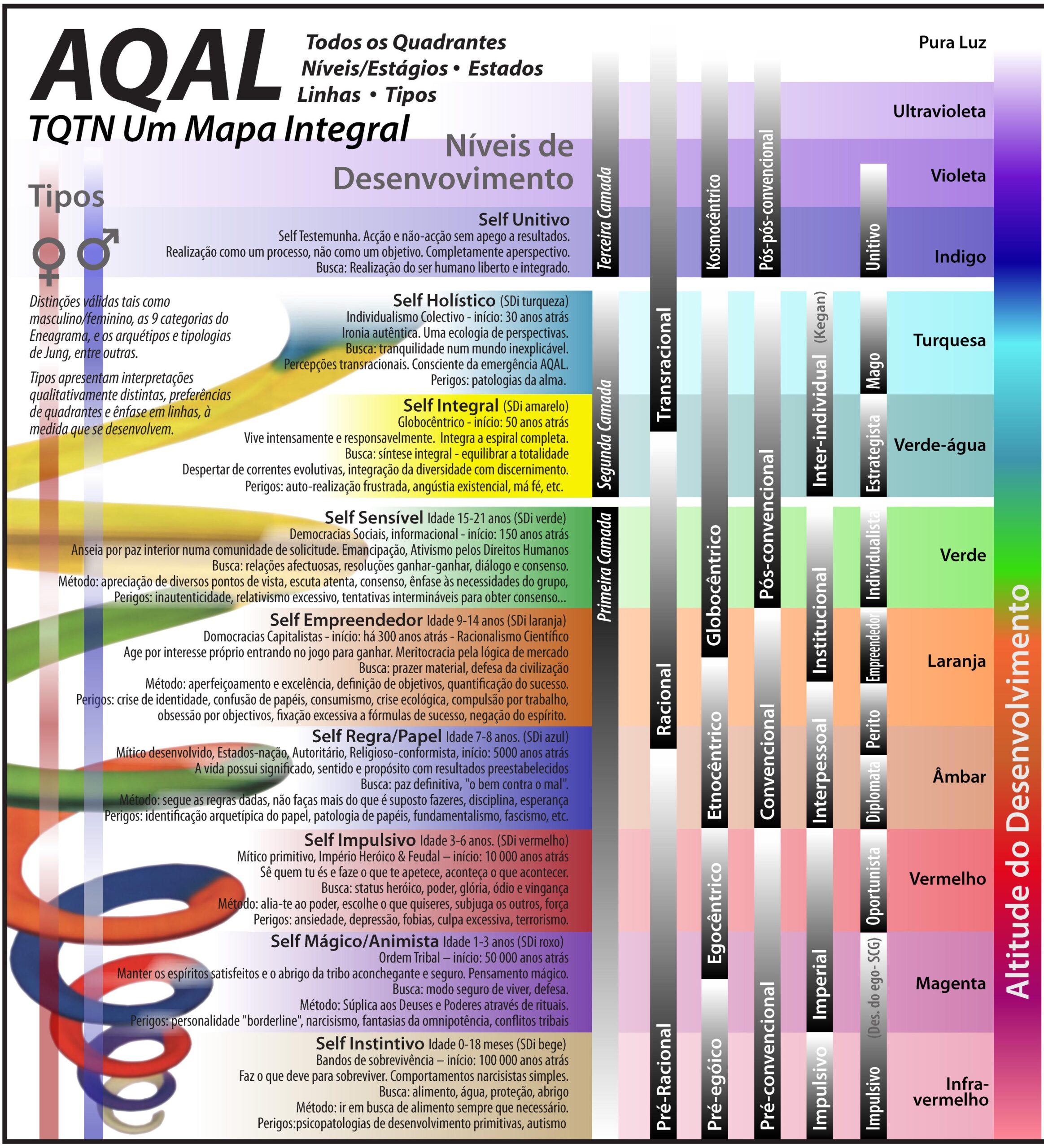

A Teoria Integral de Wilber integra várias tradições de pensamento — desde a ciência até a espiritualidade, passando pela psicologia, filosofia e sociologia — em uma estrutura unificada que busca compreender a totalidade da experiência humana. Um dos componentes mais significativos dessa teoria é a Espiral Integral, que descreve o desenvolvimento humano através de estágios ou níveis de consciência. Cada estágio, identificado por uma cor, representa uma visão de mundo única, que influencia a maneira como os indivíduos percebem a realidade e interagem com ela.

Ao aplicar essa teoria ao comportamento de consumo, torna-se possível entender como os valores, prioridades e motivações de compra mudam à medida que as pessoas evoluem através desses estágios de consciência. A compreensão dessa dinâmica pode transformar a forma como as empresas abordam o marketing, permitindo uma segmentação mais precisa, uma comunicação mais eficaz e a criação de produtos que ressoam profundamente com as necessidades e aspirações dos consumidores em diferentes estágios de desenvolvimento.

Este artigo oferece uma análise aprofundada da relação entre a Teoria da Espiral Integral de Ken Wilber e o comportamento de consumo, explorando como os diferentes níveis de consciência influenciam as decisões de compra e como os profissionais de marketing podem adaptar suas estratégias para atender melhor esses consumidores em evolução. Discutiremos os estágios da espiral, suas características e implicações para o comportamento de consumo, além de abordar os desafios e oportunidades que as marcas enfrentam ao integrar essa abordagem em suas práticas de marketing.

A Teoria Integral e a Espiral de Consciência

A Teoria Integral de Ken Wilber é uma das tentativas mais ambiciosas de integrar diversas disciplinas em uma estrutura coerente que explica a experiência humana de forma abrangente. Wilber postula que a realidade pode ser compreendida através de quatro quadrantes: individual interior (experiências pessoais), individual exterior (comportamentos observáveis), coletivo interior (valores e crenças) e coletivo exterior (estruturas sociais e sistemas). A Espiral Integral, que é uma extensão de sua teoria, mapeia a evolução da consciência humana em níveis, também chamados de memes ou estágios de desenvolvimento.

Cada estágio da espiral representa uma forma única de enxergar o mundo, com diferentes valores, motivações e estruturas cognitivas. Esses estágios não são apenas teóricos, mas também refletem as diversas fases pelas quais os indivíduos e as culturas passam em sua evolução. Wilber argumenta que, conforme os seres humanos se desenvolvem, eles “transcendem e incluem” os estágios anteriores — ou seja, cada novo nível de desenvolvimento incorpora os aspectos positivos dos níveis anteriores, enquanto transcende suas limitações.

A Espiral Integral também é dinâmica e flexível, reconhecendo que, em diferentes momentos ou contextos, os indivíduos podem exibir comportamentos ou valores característicos de estágios anteriores. Isso é particularmente relevante no campo do comportamento de consumo, onde as decisões de compra podem ser influenciadas por uma combinação de motivações que refletem múltiplos níveis de consciência.

Os Estágios da Espiral Integral

A espiral de Wilber é composta por oito níveis principais, cada um identificado por uma cor. Esses estágios descrevem como os indivíduos e as sociedades evoluem de formas mais simples e egocêntricas de pensar para formas mais complexas e integradoras. Vamos explorar cada um desses estágios em detalhes e discutir suas implicações para o comportamento de consumo.

1. Bege: Instinto de Sobrevivência

O nível Bege representa o estágio mais básico da consciência, focado exclusivamente na sobrevivência física. Neste estágio, o comportamento de consumo é puramente instintivo, motivado pela necessidade de satisfazer as necessidades mais básicas, como alimentação, abrigo e segurança. O consumo é limitado a produtos essenciais, e as decisões de compra são impulsionadas por questões de escassez e sobrevivência imediata.

Marketing para o Nível Bege:

- Neste nível, as empresas que oferecem produtos de necessidade básica, como alimentos, roupas, água potável e medicamentos, desempenham um papel crucial. Marcas que atendem a áreas de crise, desastres naturais ou situações de pobreza extrema devem se concentrar em fornecer acesso rápido e eficiente a esses bens essenciais. A ênfase deve estar na acessibilidade e na simplicidade, pois os consumidores neste nível não estão preocupados com o luxo ou com o status.

2. Roxo: Mágico-Animista

O nível Roxo é caracterizado pela crença em forças místicas e rituais tribais. As culturas neste estágio são profundamente influenciadas por tradições, símbolos e mitos, e o comportamento de consumo é guiado por um senso de pertencimento e respeito pelas práticas ancestrais. As compras são motivadas por considerações espirituais e comunitárias, e os consumidores buscam produtos que tenham um significado simbólico ou ritualístico.

Marketing para o Nível Roxo:

- As marcas podem apelar para a tradição e o simbolismo cultural ao comercializar produtos para consumidores neste nível. Isso pode incluir a promoção de produtos que tenham um significado especial em rituais ou celebrações, como roupas tradicionais, artefatos espirituais ou produtos ligados à identidade cultural. O marketing deve se concentrar em histórias e narrativas que reforcem o senso de comunidade e continuidade cultural.

3. Vermelho: Egocêntrico-Poder

O estágio Vermelho é marcado pelo egocentrismo e pela busca de poder e domínio. Neste nível, os consumidores são motivados pelo desejo de afirmar sua individualidade, força e superioridade. O consumo é impulsionado pela busca de status e controle, e as compras são frequentemente usadas como uma forma de exibir poder e independência. Produtos de luxo, carros esportivos e itens exclusivos são especialmente atraentes para os consumidores neste estágio.

Marketing para o Nível Vermelho:

- As marcas que buscam atingir esse público devem enfatizar o poder, o prestígio e a exclusividade. Campanhas publicitárias que apelam para a ideia de ser “único”, “forte” ou “poderoso” são eficazes. O marketing de luxo e de status, com ênfase em produtos que são raros ou exclusivos, ressoa bem com consumidores neste nível. Além disso, as estratégias de marketing podem focar em celebridades ou influenciadores que simbolizam força e sucesso individual.

4. Azul: Tradicional-Conformista

O nível Azul representa uma fase de desenvolvimento onde a ordem, a conformidade e os valores morais tradicionais desempenham um papel central. Consumidores neste estágio são orientados por uma necessidade de estrutura, estabilidade e uma adesão rígida a normas e regras estabelecidas. As compras são guiadas por valores de moralidade, segurança e confiabilidade. Marcas que projetam uma imagem de responsabilidade, durabilidade e autoridade são particularmente atraentes para consumidores neste nível.

Marketing para o Nível Azul:

- A comunicação de marketing deve focar em tradição, confiabilidade e responsabilidade social. Marcas com um histórico de qualidade e que promovem um forte senso de segurança, ordem e moralidade se conectam bem com esse público. Produtos que têm uma longevidade comprovada, como seguros, bancos tradicionais, e até produtos de consumo familiar, atraem consumidores do nível azul. Campanhas que destacam a conformidade com as normas sociais e a responsabilidade moral também são bem recebidas.

5. Laranja: Racional-Modernista

O nível Laranja é caracterizado pela racionalidade, inovação e o desejo de progresso. Consumidores neste estágio são orientados para o sucesso individual e buscam produtos que lhes permitam alcançar seus objetivos pessoais e profissionais. A ciência, a tecnologia e a eficiência são altamente valorizadas, e os consumidores tomam decisões de compra com base em dados objetivos, comparações e desempenho.

Marketing para o Nível Laranja:

- As marcas devem destacar a inovação, a eficiência e o sucesso pessoal. Campanhas que focam em desempenho superior, avanços tecnológicos e conquista individual ressoam fortemente com esse público. O marketing digital, que permite uma comparação direta de produtos e a transparência das informações, é particularmente eficaz. Produtos que oferecem uma vantagem competitiva, como gadgets tecnológicos, serviços de automação e educação executiva, atraem consumidores nesse nível.

6. Verde: Pluralista-Comunitário

No nível Verde, o foco está na igualdade, inclusão e bem-estar comunitário. Consumidores neste estágio são altamente sensíveis a questões sociais e ambientais e preferem marcas que promovem justiça social, diversidade e sustentabilidade. O consumo é orientado por um desejo de fazer parte de um todo maior, e as decisões de compra refletem um compromisso com o impacto positivo no mundo.

Marketing para o Nível Verde:

- As marcas devem adotar uma abordagem ética e sustentável, promovendo responsabilidade social e ambiental. Campanhas que destacam práticas ecológicas, comércio justo e impacto social positivo atraem consumidores verdes. Além disso, o marketing deve ser inclusivo e diverso, celebrando a igualdade e a justiça social. Produtos orgânicos, veganos, ou que de alguma forma contribuem para a melhoria do planeta são altamente valorizados nesse nível.

7. Amarelo: Sistêmico-Integral

O estágio Amarelo é marcado por uma visão sistêmica e integral do mundo. Consumidores neste nível reconhecem a complexidade e a interconectividade das coisas e buscam produtos e serviços que reflitam essa compreensão. A flexibilidade, a personalização e a inovação integrativa são altamente valorizadas. Consumidores neste estágio estão interessados em soluções que integrem múltiplos aspectos da vida, como tecnologia, sustentabilidade, funcionalidade e estética.

Marketing para o Nível Amarelo:

- As marcas devem enfatizar a inovação multifuncional e a personalização. Produtos que oferecem uma abordagem holística e que integram diferentes necessidades são atraentes para consumidores amarelos. Além disso, o marketing deve focar na adaptabilidade e flexibilidade dos produtos. Soluções modulares ou personalizáveis, que possam ser ajustadas para atender às necessidades individuais, têm grande apelo nesse nível.

8. Turquesa: Holístico-Integral

O nível Turquesa é o estágio mais elevado da espiral, onde a consciência holística e a interconexão de todas as coisas são plenamente reconhecidas. Consumidores neste estágio são guiados por uma visão global e ecológica e buscam produtos e serviços que promovam o bem-estar coletivo e a harmonia planetária. O consumo é orientado pelo compromisso com o bem-estar de toda a humanidade e do planeta, e as decisões de compra refletem um profundo senso de responsabilidade global.

Marketing para o Nível Turquesa:

- As marcas devem adotar uma abordagem profundamente ética e regenerativa. Produtos que promovem a sustentabilidade planetária, a harmonia entre as espécies e o bem-estar coletivo são essenciais. Além disso, o marketing deve ser profundamente inclusivo, focando no impacto positivo para o planeta como um todo. Marcas que demonstram um compromisso genuíno com a regeneração ecológica e a cura global ressoam com consumidores turquesa.

Implicações da Teoria Integral para o Marketing

A Teoria Integral e sua Espiral de Consciência oferecem aos profissionais de marketing uma ferramenta poderosa para entender a complexidade das motivações de consumo. Ao reconhecer que os consumidores evoluem através de diferentes estágios de consciência, as marcas podem adaptar suas estratégias para atender melhor às necessidades e valores desses consumidores em evolução.

- Segmentação Dinâmica: A espiral permite que as marcas segmentem os consumidores não apenas com base em dados demográficos tradicionais, mas também em seu nível de desenvolvimento de consciência. Isso oferece uma segmentação mais precisa e eficaz, permitindo que as empresas adaptem suas mensagens para ressoar com os valores específicos de cada grupo.

- Ciclo de Vida do Produto: O ciclo de vida dos produtos também pode ser visto sob a lente da espiral. Produtos que inicialmente atraem consumidores em um estágio podem evoluir para atrair consumidores em níveis mais elevados. Por exemplo, um produto inicialmente comercializado para consumidores em um nível Laranja (focado em inovação) pode ser reformulado para atrair consumidores em um nível Verde (focado em sustentabilidade), à medida que as preferências dos consumidores mudam.

- Construção de Relacionamentos: Ao entender que os consumidores estão em constante evolução, as marcas podem criar estratégias de fidelização que acompanham essa jornada. Isso significa desenvolver produtos e campanhas que evoluem junto com os consumidores, criando relacionamentos mais profundos e duradouros.

- Marketing Holístico: A espiral incentiva as marcas a adotarem uma abordagem mais holística ao marketing, integrando considerações ambientais, sociais e tecnológicas em suas estratégias. Isso não apenas atrai consumidores nos níveis mais elevados da espiral, mas também ajuda a posicionar a marca como uma líder ética e inovadora no mercado.

Desafios e Oportunidades

Integrar a Teoria Integral ao marketing apresenta tanto desafios quanto oportunidades. Um dos principais desafios é que nem todos os consumidores se encontram no mesmo estágio da espiral, o que exige que as marcas desenvolvam estratégias de comunicação diferenciadas para atingir públicos em diferentes níveis de consciência.

Além disso, as marcas devem ser autênticas em sua abordagem. Consumidores nos estágios mais elevados da espiral, especialmente Verde e Turquesa, são altamente sensíveis à hipocrisia e ao marketing superficial. Portanto, as empresas que desejam se posicionar como sustentáveis ou socialmente responsáveis devem realmente praticar o que pregam, sob pena de alienar seus consumidores mais conscientes.

Por outro lado, as oportunidades são vastas. Marcas que conseguem integrar a espiral em suas práticas de marketing não apenas conquistam consumidores mais leais e engajados, mas também podem liderar o caminho em termos de inovação ética e sustentabilidade. Ao entender e respeitar a evolução dos consumidores, as marcas podem se tornar agentes de transformação positiva no mundo.

Conclusão

A Teoria Integral de Ken Wilber oferece uma nova maneira de entender o comportamento de consumo e as motivações dos consumidores. Ao aplicar a Espiral de Consciência ao marketing, as empresas podem desenvolver estratégias mais eficazes, adaptadas aos diferentes níveis de desenvolvimento dos consumidores. Isso permite que as marcas não apenas atendam às necessidades atuais de seus consumidores, mas também evoluam com eles, criando produtos e campanhas que ressoam profundamente com seus valores e aspirações em constante mudança.

Em última análise, a Espiral Integral não é apenas uma ferramenta para entender o comportamento de consumo, mas também um convite para as marcas se tornarem mais conscientes e responsáveis em suas práticas de marketing. Ao abraçar essa abordagem holística, as empresas podem não apenas prosperar no mercado, mas também contribuir para o bem-estar coletivo e a evolução da sociedade como um todo.

Introdução

Nos últimos anos, o avanço da neurociência tem proporcionado uma compreensão mais profunda sobre o funcionamento do cérebro humano e o papel das emoções nas decisões de consumo. O artigo “Decisões e Desejos”, de Gardiner Morse (2006), publicado na Harvard Business Review, revela que o processo de tomada de decisão não é guiado apenas pela razão, como tradicionalmente se acreditava, mas também por impulsos emocionais profundos. Este entendimento tem transformado a maneira como o marketing aborda os consumidores, proporcionando insights valiosos sobre como estimular o consumo, criar associações para a redução do risco percebido e influenciar compras por impulso.

Este artigo busca aprofundar a discussão sobre como o marketing pode utilizar o conhecimento sobre o funcionamento do cérebro e a interação entre razão e emoção para criar campanhas mais eficazes, estimular o comportamento de compra e influenciar decisões. Exploraremos também como a comunicação, o design de estratégias de marketing e a criação de estímulos podem ser aprimorados com base em tais insights.

A Interação entre Emoção e Razão no Processo de Decisão de Compra

A ideia de que as emoções influenciam as decisões de compra tem sido central em muitos estudos de neuromarketing. Como exposto por Morse, embora o cérebro humano tenha evoluído para incluir o córtex pré-frontal, responsável pelo planejamento e deliberação, nossas decisões ainda são fortemente influenciadas por regiões mais antigas, como a ínsula anterior, associada a emoções negativas. A pesquisa sobre o jogo do ultimato, citado no artigo, mostra que decisões aparentemente irracionais, como a recusa de uma oferta monetária baixa, podem ser explicadas pela ativação de emoções como a raiva.

No marketing, essa relação entre emoção e razão desempenha um papel crucial. Enquanto o consumidor pode racionalizar a compra de um produto, fatores emocionais frequentemente influenciam a decisão final. Por exemplo, em uma campanha publicitária, o apelo emocional — seja por meio de imagens, sons ou histórias — pode ativar regiões do cérebro associadas ao prazer ou à empatia, aumentando as chances de uma resposta positiva à mensagem.

Aplicações no Marketing

- Apelo Emocional: Campanhas de marketing que apelam para emoções, como felicidade, nostalgia ou pertencimento, podem criar uma conexão emocional forte com os consumidores, aumentando o engajamento com a marca. Anúncios que utilizam histórias envolventes, personagens com os quais o público se identifica ou trilhas sonoras que evocam sentimentos positivos podem ativar o sistema de recompensa do cérebro, tornando a marca mais atraente.

- Criação de Experiências de Consumo: Além de vender produtos, as marcas podem se concentrar na criação de experiências memoráveis. A experiência de compra, seja online ou em lojas físicas, pode ser projetada para estimular emoções positivas, desde o design do ambiente até o atendimento ao cliente. Experiências que provocam prazer e satisfação podem aumentar a fidelidade à marca.

- Engajamento através de Conteúdo: O conteúdo publicitário pode ser desenvolvido com o objetivo de provocar emoções específicas, que são fortemente associadas à marca. Campanhas que utilizam temas sociais, como sustentabilidade ou igualdade, podem gerar emoções de empatia e identificação com causas importantes para os consumidores, ajudando a fortalecer a conexão emocional com a marca.

O Papel do Marketing na Redução do Risco Percebido

Outra área importante do marketing, relacionada ao comportamento do consumidor, é a redução do risco percebido. O risco percebido pode ser uma barreira significativa para a decisão de compra, especialmente quando o consumidor está considerando a compra de produtos ou serviços caros, ou de empresas desconhecidas. De acordo com o artigo de Morse, o cérebro humano é naturalmente avesso ao risco, com regiões como a amígdala e a ínsula anterior sendo ativadas quando percebemos uma ameaça ou risco.

O marketing pode usar várias táticas para reduzir o risco percebido e, assim, facilitar o processo de tomada de decisão. A confiança, a familiaridade e a segurança emocional são fatores-chave que podem ser ativados pelas estratégias de marketing.

Estratégias para Redução do Risco

- Construção de Confiança na Marca: A confiança é um dos fatores mais importantes para reduzir o risco percebido pelos consumidores. Quando uma marca se posiciona como confiável e transparente, o consumidor sente-se mais seguro em tomar decisões de compra. A confiança pode ser construída através de campanhas consistentes, depoimentos de clientes satisfeitos, certificações de qualidade e parcerias com influenciadores respeitados.

- Provas Sociais: O uso de avaliações, classificações e depoimentos de clientes ajuda a reduzir o risco percebido. Estudos mostram que os consumidores tendem a confiar em avaliações de outros consumidores mais do que em mensagens diretas das marcas. Além disso, depoimentos de especialistas ou influenciadores respeitados podem servir como uma forma de validação social, criando uma sensação de segurança para os consumidores que estão em dúvida sobre a compra.

- Garantias e Políticas de Retorno: Políticas de garantia de devolução do dinheiro ou facilidade de troca e devolução também ajudam a reduzir o risco percebido. Essas medidas oferecem uma sensação de segurança, pois garantem ao consumidor que ele não ficará preso a um produto que não atenda às suas expectativas.

- Uso de Selos de Segurança e Certificações: Em e-commerces ou em produtos que exigem maior confiança, o uso de selos de segurança, como certificações de qualidade ou garantias, pode tranquilizar os consumidores. Essas certificações funcionam como uma validação externa da confiabilidade da marca, especialmente em setores que envolvem saúde ou finanças.

A Influência do Marketing no Comportamento de Compra por Impulso

A compra por impulso é um comportamento que ocorre quando os consumidores tomam decisões rápidas, baseadas em emoções momentâneas, sem uma deliberação cuidadosa. Estudos neurocientíficos, como os discutidos por Morse, mostram que o cérebro processa recompensas de forma muito rápida e poderosa, com a dopamina desempenhando um papel crucial na busca por essas recompensas. Essa busca por gratificação imediata está no centro do comportamento de compra por impulso.

O marketing pode, intencionalmente, criar estímulos que incentivem a compra impulsiva, utilizando estratégias que reforcem a gratificação imediata e eliminem possíveis barreiras racionais à decisão de compra.

Estímulos que Incentivam a Compra por Impulso

- Escassez e Urgência: Campanhas que utilizam técnicas de escassez, como “estoque limitado” ou “oferta por tempo limitado”, ativam o medo da perda, desencadeando respostas emocionais que motivam o consumidor a agir rapidamente. A ativação da amígdala e do sistema de recompensa pode levar à tomada de decisões imediatas, mesmo sem reflexão consciente.

- Promoções e Descontos Relâmpago: Ofertas especiais, como descontos relâmpago ou cupons que expiram em um curto período de tempo, incentivam a ação rápida, removendo o tempo de deliberação. A expectativa de economizar dinheiro pode ser vista como uma recompensa imediata, aumentando a probabilidade de uma compra impulsiva.

- Design de Produtos e Embalagens: O design de produtos e embalagens também pode ser otimizado para incentivar compras por impulso. Produtos dispostos em áreas de alto tráfego nas lojas, como caixas de supermercado, e embalagens atraentes que chamam a atenção imediatamente, podem influenciar a decisão de compra no momento em que o consumidor está prestes a finalizar a compra.

- Sugestões Personalizadas: Em e-commerces, o uso de recomendações personalizadas de produtos com base no histórico de navegação ou compras anteriores pode incentivar a compra impulsiva. Ao apresentar produtos que o consumidor já demonstrou interesse, o e-commerce cria um contexto de familiaridade e confiança, facilitando a decisão de compra sem deliberação prolongada.

O Processo de Comunicação no Marketing e o Papel da Neurociência

A comunicação eficaz é uma das principais ferramentas do marketing para influenciar o comportamento de compra. Com base nos insights da neurociência, as marcas podem ajustar suas mensagens de forma a atingir diretamente os circuitos emocionais dos consumidores. A maneira como uma mensagem é formulada, o tom usado e os canais de comunicação escolhidos podem fazer toda a diferença na resposta emocional e na eventual decisão de compra.

Otimização da Comunicação com Base em Emoções

- Narrativas que Evocam Emoções: Contar histórias que provocam emoções positivas, como esperança, alegria ou conexão, pode engajar os consumidores de maneira profunda. Narrativas são especialmente eficazes porque o cérebro humano processa informações através de histórias de forma mais intuitiva do que por meio de argumentos lógicos e abstratos. Um anúncio que conta a história de um cliente superando um desafio pessoal com a ajuda de um produto, por exemplo, pode gerar empatia e identificação.

- Uso de Imagens e Sons que Ativam Respostas Emocionais: Além das palavras, o uso de imagens e sons é uma poderosa forma de influenciar emoções. Imagens de pessoas sorrindo, cenas de natureza ou momentos de celebração ativam áreas do cérebro associadas ao prazer e ao bem-estar. Da mesma forma, trilhas sonoras agradáveis podem criar uma associação positiva com a marca.

- Mensagens Simples e Diretas: O cérebro humano é mais propenso a reagir de forma positiva a mensagens simples e claras. As campanhas de marketing que apresentam uma proposta de valor direta, com menos sobrecarga de informações, têm maior probabilidade de ativar a resposta emocional desejada e evitar a paralisia da decisão causada pela sobrecarga cognitiva.

- Estimulação de Recompensa Antecipada: A antecipação de uma recompensa, como um brinde ou um bônus, pode ativar o núcleo accumbens, gerando um desejo de ação. Mensagens que prometem recompensas futuras, como “Compre agora e ganhe um desconto exclusivo” ou “Inscreva-se e receba seu primeiro mês grátis”, incentivam os consumidores a agir, atraídos pela expectativa da recompensa.

O Futuro do Marketing com Base na Neurociência

O campo do neuromarketing, embora ainda esteja em desenvolvimento, já oferece insights valiosos sobre como o cérebro humano responde a estímulos de marketing. As descobertas da neurociência estão sendo usadas para refinar campanhas publicitárias, melhorar a experiência do consumidor e aumentar a eficácia das estratégias de marketing.

No futuro, à medida que mais informações sobre o funcionamento do cérebro forem descobertas, as marcas poderão personalizar ainda mais suas abordagens de marketing, criando mensagens altamente eficazes que ressoem com os impulsos emocionais e cognitivos dos consumidores. Além disso, o uso de tecnologias avançadas, como a inteligência artificial e o aprendizado de máquina, poderá tornar essa personalização ainda mais precisa, permitindo que as marcas ofereçam o produto certo, no momento certo, com a mensagem certa.

Conclusão

A compreensão do funcionamento do cérebro, especialmente a interação entre emoção e razão na tomada de decisões, está revolucionando o marketing. O marketing contemporâneo se vale de insights da neurociência para influenciar o comportamento de compra, reduzir o risco percebido e estimular decisões impulsivas. Com estratégias que ativam diretamente os circuitos emocionais, as marcas podem criar experiências de consumo mais envolventes e eficazes, facilitando a conexão emocional com os consumidores e influenciando as decisões de compra de maneira mais assertiva.

À medida que o neuromarketing evolui, ele se torna uma ferramenta indispensável para as marcas que buscam compreender e influenciar os processos inconscientes que orientam o comportamento de consumo. Assim, o marketing não é apenas uma ciência de persuasão, mas também uma ciência que, agora mais do que nunca, deve levar em conta as complexas interações entre emoção, razão e contexto cultural dos consumidores.

Introdução

No cenário competitivo atual, as marcas buscam constantemente maneiras de se destacar e construir relacionamentos duradouros com seus consumidores. Entre as diversas estratégias de marketing, o papel dos “Heróis da Marca” tem ganhado destaque. Estes são consumidores que não apenas utilizam os produtos de uma marca, mas também se tornam seus defensores mais fervorosos, influenciando a percepção e comportamento de outras pessoas em relação à marca. Este artigo explora o conceito central dos Heróis da Marca, como a escala de Heróis da Marca (BHS) foi desenvolvida, e apresenta uma classificação lúdica e didática dos diferentes níveis de heróis da marca.

Conceito de Heróis da Marca

Os Heróis da Marca são consumidores que exibem um forte vínculo emocional e comportamental com uma marca. Eles não apenas compram e usam os produtos, mas também compartilham suas experiências positivas com outros, defendem a marca em situações adversas e promovem ativamente seus méritos. Esses consumidores apaixonados desempenham um papel crucial na construção da reputação da marca, especialmente em um mundo onde o boca-a-boca e as recomendações pessoais têm um impacto significativo nas decisões de compra.

Definição e Características

Segundo Lin, Foscht e Eisingerich (2023), Heróis da Marca são definidos como indivíduos cujas experiências personalizadas com a marca e paixão motivam-nos a mudar a percepção de outras pessoas sobre a marca através do uso frequente, persuasivo e emocional do boca-a-boca (WOM). Eles combinam informações sobre a marca com emoções, tornando suas comunicações mais convincentes e impactantes.

As principais características dos Heróis da Marca incluem:

- Motivação Intrínseca: Eles são movidos por uma motivação interna para influenciar a opinião dos outros sobre a marca, ao invés de fatores externos ou recompensas.

- Experiências Pessoais e Conexão com a Marca: Eles têm experiências personalizadas e significativas com a marca, o que fortalece sua conexão e paixão pela marca.

- Comunicação Persuasiva e Emocional: Eles não apenas informam sobre a marca, mas fazem isso de uma maneira que combina informações com emoções, tornando suas mensagens mais convincentes e impactantes.

Desenvolvimento da Escala de Heróis da Marca (BHS)

Para quantificar e classificar os Heróis da Marca, os autores desenvolveram a escala de Heróis da Marca (BHS). Esta escala foi projetada para medir o nível em que os consumidores exibem comportamentos e características associadas a serem defensores apaixonados e persuasivos de uma marca. O desenvolvimento da BHS envolveu várias etapas, incluindo entrevistas exploratórias, estudos empíricos e análises estatísticas.

Etapas do Desenvolvimento da Escala

- Entrevistas Exploratórias:

- Foram conduzidas entrevistas semi-estruturadas com acadêmicos, especialistas da indústria e consumidores. O objetivo dessas entrevistas foi obter insights qualitativos sobre os comportamentos e motivações dos Heróis da Marca.

- Desenvolvimento Inicial de Itens:

- Com base nas entrevistas, foi gerado um conjunto inicial de 18 itens que representavam diferentes aspectos do comportamento dos Heróis da Marca. Esses itens foram refinados para eliminar redundâncias e melhorar a clareza.

- Validação Inicial:

- Um estudo piloto foi realizado com estudantes universitários para testar a confiabilidade e validade dos itens. A análise resultou na redução dos itens para 16, mantendo aqueles que mostraram maior correlação com os critérios de validação.

- Estudos Principais:

- Três estudos principais foram conduzidos para validar a escala BHS em diferentes contextos de marca e populações. Esses estudos avaliaram a confiabilidade, validade convergente, discriminante e preditiva da escala.

Estrutura da Escala BHS

A versão final da escala BHS consiste em seis itens, cada um projetado para capturar um aspecto específico dos Heróis da Marca. Os itens são avaliados em uma escala de 1 a 9, onde 1 significa “discordo totalmente” e 9 significa “concordo totalmente”. Os escores de todos os seis itens são somados para obter um escore total para cada indivíduo, que pode variar de 6 a 54.

Os seis itens da BHS são:

- “Sou bastante persuasivo ao convencer os outros sobre o quão ótima é esta marca.”

- “Quero mudar como outras pessoas pensam ou entendem esta marca.”

- “Falo sobre esta marca sempre que encontro uma oportunidade de fazê-lo.”

- “Falo aos outros sobre esta marca porque sou apaixonado por ela.”

- “Aprecio profundamente as experiências emocionais que tive ao usar esta marca.”

- “Quando falo com os outros sobre esta marca, tendo a ficar animado e emocional.”

Classificação dos Níveis de Heróis da Marca

Com base na pontuação total obtida na escala BHS, é possível classificar os Heróis da Marca em diferentes níveis. Para tornar essa classificação mais didática e lúdica, adotamos uma temática de super-heróis. Os níveis são:

- Explorador da Marca (6-18 Pontos):

- Descrição: Exploradores da Marca são aqueles que estão começando a conhecer a marca e ainda não têm um forte envolvimento com ela. Eles usam os produtos, mas não se sentem compelidos a falar sobre suas experiências.

- Comportamento: Exploradores tendem a responder de forma neutra quando perguntados sobre a marca e não se sentem motivados a influenciar os outros.

- Aliado da Marca (19-30 Pontos):

- Descrição: Aliados da Marca são consumidores que apoiam a marca de maneira moderada. Eles falam sobre a marca ocasionalmente, recomendando-a para amigos e familiares, e mostram um interesse crescente.

- Comportamento: Aliados levantam suas vozes para apoiar a marca e compartilham suas boas experiências com pessoas próximas.

- Campeão da Marca (31-42 Pontos):

- Descrição: Campeões da Marca são os verdadeiros heróis que defendem a marca com entusiasmo e paixão. Eles frequentemente falam sobre a marca, influenciando outras pessoas de forma significativa e positiva.

- Comportamento: Campeões falam com paixão e convicção sobre a marca, influenciando amigos, familiares e até desconhecidos a adotarem a marca com a mesma intensidade.

- Guardião da Marca (43-54 Pontos):

- Descrição: Guardiões da Marca são consumidores altamente leais que não apenas defendem a marca, mas também protegem sua reputação. Eles intervêm em discussões negativas e ajudam a resolver problemas para manter a integridade da marca.

- Comportamento: Guardiões são os protetores incansáveis, garantindo que a reputação da marca permaneça intacta e ajudando a resolver qualquer situação adversa.

- Embaixador da Marca (55-60 Pontos):

- Descrição: Embaixadores da Marca são consumidores que atuam como representantes informais da marca. Eles compartilham suas histórias e experiências de maneira tão persuasiva que se tornam influenciadores naturais.

- Comportamento: Embaixadores são os rostos e vozes que representam a marca em suas comunidades. Suas histórias cativantes inspiram outros a seguir seus passos e a adotar a marca com entusiasmo.

Aplicações Práticas da Escala BHS

A BHS oferece uma maneira estruturada e quantitativa de avaliar e categorizar os Heróis da Marca, permitindo que as empresas entendam melhor e aproveitem o poder desses defensores apaixonados e persuasivos. A seguir estão algumas das aplicações práticas da escala:

Segmentação de Marketing

Com base nos escores da BHS, os gerentes de marketing podem segmentar seus clientes em diferentes níveis de Heróis da Marca e personalizar suas estratégias de comunicação e engajamento de acordo. Por exemplo, enquanto os Exploradores podem precisar de mais informações e incentivos para se tornarem defensores ativos, os Campeões e Guardiões podem ser engajados em campanhas de marketing para promover a marca de maneira mais intensa.

Identificação de Influenciadores

Indivíduos com altos escores na BHS podem ser identificados como potenciais influenciadores que podem ser engajados em campanhas de marketing para promover a marca. Eles podem ser convidados a participar de eventos exclusivos, receber produtos gratuitos ou benefícios especiais em troca de seu apoio contínuo.

Desenvolvimento de Programas de Fidelidade

Marcas podem desenvolver programas de fidelidade e advocacia específicos para cada nível de Herói da Marca, incentivando comportamentos positivos e aumentando a lealdade. Por exemplo, programas de fidelidade para Embaixadores podem incluir recompensas por trazer novos clientes ou por compartilhar suas experiências em plataformas de mídia social.

Estudos de Caso e Exemplos Práticos

Para ilustrar a aplicação da BHS na prática, vamos explorar alguns exemplos de marcas que têm aproveitado com sucesso o poder dos Heróis da Marca.

Estudo de Caso 1: Nike

A Nike é um exemplo clássico de uma marca que tem uma base de fãs leais e apaixonados. Seus Embaixadores da Marca incluem atletas de renome mundial, bem como influenciadores nas redes sociais que compartilham suas experiências positivas com os produtos da Nike. A empresa frequentemente organiza eventos exclusivos e oferece produtos em edição limitada para esses defensores, incentivando-os a continuar promovendo a marca.

Estudo de Caso 2: Starbucks

Starbucks tem uma comunidade de Guardiões da Marca que defendem a empresa em situações adversas e ajudam a resolver problemas de clientes. Esses consumidores leais frequentemente compartilham suas experiências nas redes sociais e participam de campanhas de marketing da Starbucks, promovendo novos produtos e iniciativas.

Estudo de Caso 3: Apple

Apple tem uma base de fãs que inclui Campeões e Embaixadores da Marca. Os consumidores da Apple frequentemente falam com paixão sobre seus produtos e influenciam outros a adotarem a marca. A empresa incentiva esse comportamento através de programas de recompensas, eventos exclusivos e suporte ao cliente de alta qualidade.

Conclusão

Os Heróis da Marca desempenham um papel crucial na construção da reputação e lealdade da marca. Com a escala de Heróis da Marca (BHS), as empresas podem identificar e engajar esses consumidores de maneira mais eficaz, aproveitando seu poder de influência para promover e proteger a marca. A classificação lúdica dos diferentes níveis de Heróis da Marca ajuda a tornar o conceito mais acessível e compreensível, permitindo que as marcas desenvolvam estratégias de marketing personalizadas e eficazes.